AI関連のネタ。

このネタは、科学技術や未来を左右する重要なものだが、SFとしても鉄板のアイデアになっている。

わたしたちは、今、そのターニングポイントにいるのだと思う。

ただし、真にAIが覚醒するのかどうかは未知数だ。

それが可能かどうかも、現時点では明確ではない。シンギュラリティは来ないかもしれないのだ。

4年前の「AIがチューリングテスト合格」騒動は何だったのか ITmedia NEWS

「人間と同じ知能を持った人工物を作る」という人間の夢は、古くはギリシャ神話、錬金術、機械人形など、さまざまな形で実現しようとしてきました。

(中略)

ところで、人工知能が完成したとして「人間と同じ知能を持つ」とどのように証明すればいいのでしょうか。

(中略)

14年6月8日、英国レディング大学で実施された実験において、ウクライナ在住の13歳の少年という設定の「Eugene Goostman」なるスーパーコンピュータが、審査員の30%以上に「人間である」と間違われ、チューリングテストに初めて合格したとして話題になりました。

(中略)

何より、論文を読めば分かるのですが、チューリング自身はこの対照実験を通じて人工知能を判定しようとはしていません。あくまで「機械は考えることができるのか?」を提示して、それは十分に可能であると論証しているだけです。

実験方法を「チューリングテスト」と命名すらしていません。どこかのタイミングで「思考する機械」=「人工知能」と入れ替わったのでしょう。どうりで論拠というか証明したい事項に対して、実験方法が曖昧に過ぎると思いました。

やはり、意味が分からなかったら原典に立ち返るべきです。

チューリングは本論文で何を言いたかったのか。私が感じたのは、「思考する行為」と「思考しているフリの行為」の違いは何かという問題提起です。

なかなか興味深い内容だね。

AIが人間を超えるというのは、どういうことなのか?……という問題。

チューリングテストは、人間かAIかを判別できるとされたテストだが、そのテスト方法そのものに問題があるという指摘。

じゃあ、AIが人間を超えたかどうかを判別する方法とは?

という、前提に戻ってしまう。

卵が先か鶏が先か?……みたいな話。

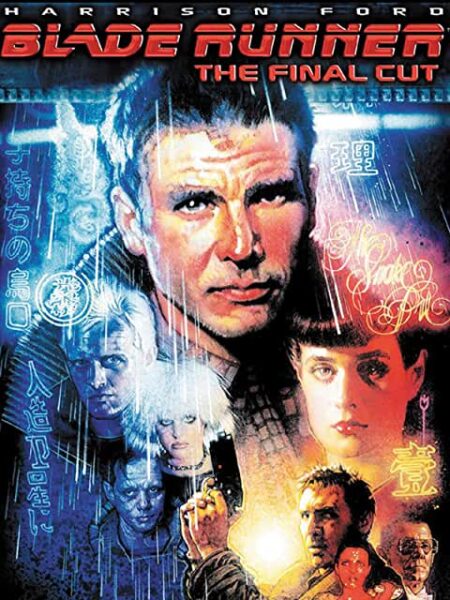

映画『ブレードランナー』で、デッカーがレプリカントかどうかを判別するテスト(フォークト=カンプフ検査(Voight-Kampff Testing))を連想する。

レプリカントはアンドロイドというよりは、遺伝子工学の産物としての人造人間だが、肉体的には人間と変わらないため、CTスキャナー等で体を透視しても判別できない。そのため、設問による反応の違いから、人間かどうかを判別していた。

AIに対するチューリングテストで行われるのも、設問に対する答から、人間的かどうかを判別するというものだが、主観的な判断になるためかなり曖昧だ。このテストを、人間に対して行ってみたら、おバカな人間は「人間じゃない」と判定されてしまいそうだ(笑)。

記事中で特に共感したのは、

「思考する行為」と「思考しているフリの行為」の違いは何か

というフレーズ。

そうそう、現在の対話型AIがやっているのは、「思考しているフリの行為」であって、言い換えれば演技であり嘘なんだ。ようするに、人をだますことで、あたかもAIに知能があるかのように振る舞っているだけ。ある意味、悪意も善意もない詐欺師なのだ。

「嘘つきは泥棒の始まり」といって、嘘をつくことはいけないと諭す。

しかし、AIは嘘つきが前提だ(笑)。Pepper、りんな、SiriなどのAIキャラクターは、人との会話の中で、もっともらしい受け答えをしていても、それらは膨大な過去データから選択された模範解答にすぎず、発せられる言葉に意思はない。

返答に同情的な言葉や、褒める言葉があったとしても、そこに真意がないという意味において「嘘」ではあるのだが、われわれはAIの嘘を歓迎すらしている。

嘘つきの人間は信用されないが、嘘つきのAIは喜ばれる。

この矛盾は、いったいなんだろうね。

嘘が上手なAIを相手に、「思考する行為」と「思考しているフリの行為」を見分けるのは困難……というか、ほぼ不可能に近いのではないか?

「君は正直者か、嘘つきか、正直者であることを証明してみよ」……という、証明不可能な問題を解くことになってしまう。

AIが人間を超えたかどうか?……の問いの場合、「知能」が問題にされる。

では、知能とはなんなのか?

生物学的立場からは新しい環境に対する先天的および後天的な適応可能性と定義され,また心理的機能の面から知覚,弁別,記憶,思考などの知的な諸機能の複合としても定義される。……ブリタニカ国際大百科事典 小項目事典の解説より

知能には,いろいろな定義があるが,3種類に大別できる。第1は,適応力とみる定義で,新しい場面や困難な問題に直面したとき,本能的な方法によらずに,適切かつ有効なしかたで,順応したり解決したりする能力を知能とみなす。第2は,抽象的思考力,推理力,洞察力などの高等な知的能力とみる定義で,言語や記号などを用いて,概念のレベルで思考を進める能力を知能とみなす。第3は,学習能力とみる定義で,知識や技能を経験によって獲得することを可能にする能力を知能とみなす。……世界大百科事典 第2版の解説より

知能には種々の定義があるが、比較的広く受け入れられているものを類型化すると、次の六つに大別される。

(1)抽象的思考力を重視するもの

(2)学習する能力とみなすもの

(3)新しい環境に対する適応性を強調するもの

(4)包括的に定義しようとするもの

(5)操作的定義

(6)情報処理の能力

……日本大百科全書(ニッポニカ)の解説より(詳細は省略)

わかったような、わからないような、曖昧な定義だ(笑)。

人間とAIの知能を対比するケースが出てきたことで、知能についての再定義が必要な気がする。つまり、AIにも適用できる知能の定義だ。

上記の定義の中では、もっとも細かい設定をしているのが、日本大百科全書(ニッポニカ)ではあるが、挙げられている6項目は、ほぼ現状のAIでも達成されていると解釈できる。なぜかというと、人間の行動や言動を模倣することで、AIは嘘がつけてしまうからだ。

抽象的思考力はAIには難しいとされるものだが、抽象的思考の産物である人間の著作や作品を参考にして、類似した解答をすることは可能だ。その答が、ほんとうに抽象的思考をしたかどうかに関係なく、模倣することで代替できてしまう。人間の創作活動は、先人たちの模倣から始まるのだから、AIが模倣したからといって、それが創作ではないと否定はできない。

やっかいだ(笑)

人間の知能と、AIの知能の区別が難しい。AIが学習すればするほど、模倣する嘘は巧妙になっていく。見破れない嘘は、もはや嘘ではなくなる。生物か機械かという物理的な違いを除けば、人間とAIの知能を判別するのは困難になる。

AIの知能が人間を超えるかどうかではなく、いかに知能を模倣するか?……になっているのではないか。人間の知能を超えているように見える、AIの模倣能力だ。

それを「模擬知能」とでも呼ぼうか。

模擬知能でも機能としては十分な場合は少なくないから、人間を超える超えないは問題じゃないのかもしれない。AIが嘘つきだとしても、そこに悪意はなく、心もないが、AIの嘘を許容する人にとっては善意の嘘に変わる。

もしかしたら、嘘が上手なAIを作ることが間違っているのかもしれない。愛嬌を振りまくPepperは、心を持たず、感情も持たないが、上手に嘘を言い演技する。人はそれが嘘だとわかっていても、感情移入してPepperに“心”を付与してしまう。

嘘をつかない、バカ正直なAIだったらどうだろう?

お世辞はいわない、ジョークもいわず、ネガティブなことでもストレートにいってしまう。それだと、反感を買いやすいAIになりそう。

人間かAIかを判別するための、新チューリングテストというか、レプリカントを判別するためのフォークト=カンプフ検査に相当するテスト方法が必要だ。そのテストがなければ、人かAIかを判別できず、人間の知能を超えたかどうかも判定できない。

ひとつ、アイデアがあるのだが、「冷たい方程式問題」がそれ。

なんのことかって?

SFファンなら知ってるよね。

ただ、これには弱点というか盲点がある。

どんなテストを考えたとしても、そのテストについての解答例をAIが学習してしまうと、容易に模倣されてしまうことだ。

となると、やはり嘘つきAIは、好ましい方向性ではないといえるかもしれない。

コメント